はじめに

近年、AIによる画像生成技術が驚くべき進化を遂げています。

その中でも「Stable Diffusion(ステーブル・ディフュージョン)」は、世界中のクリエイターや開発者の間で高く評価されているオープンソースの画像生成AIです。

その理由は、世間で知られているAI生成ツールがプロンプトに依存する一方で、Stable Difutionはプロンプトに加えて、顔や服、スタイルなどを学習させたファイルを組み合わせたり、AI動画をフレーム単位で修正するなど、一般的な生成AIには無いクオリティの安定性にあります。

本記事では、Stable Diffusionの基本的な特徴から、どんなことができるのか、どうやって使い始めるのかまで、初心者向けにわかりやすく解説します。

迷ったら先ずはコレ!

最新AIボイスレコーダーについて学ぶ↓↓

Stable Diffusionとは?

Stable Diffusionは、高品質なAI画像を生成できるAIモデルで、以下のような特徴があります:

①テキストから画像を生成(高クオリティ‼)

②オープンソースで、誰でも無料で使える

③自分のPCやクラウド上でカスタマイズ可能

④イラスト・写真風・アニメ調など幅広い作風に対応

→これらがネット不要で完全ローカル環境で利用できます!!!

これにより、デザイン経験がない人でも、わずかな操作でプロレベルのビジュアルを作成できます。

どんなことができるの?(詳しく解説)

Stable Difutionではどんなことができるのか解説します。ざっくり下記のことがメインで可能とされています。

①画像生成

②動画生成

③オリジナルキャラクターデザイン(顔、服、スタイルなど)

④コラージュ生成(構図やポーズの固定)

他にもたくさんの拡張機能があり、より洗練されたイラストのデザインができます!

これらの内容を詳しく説明いたしますと:

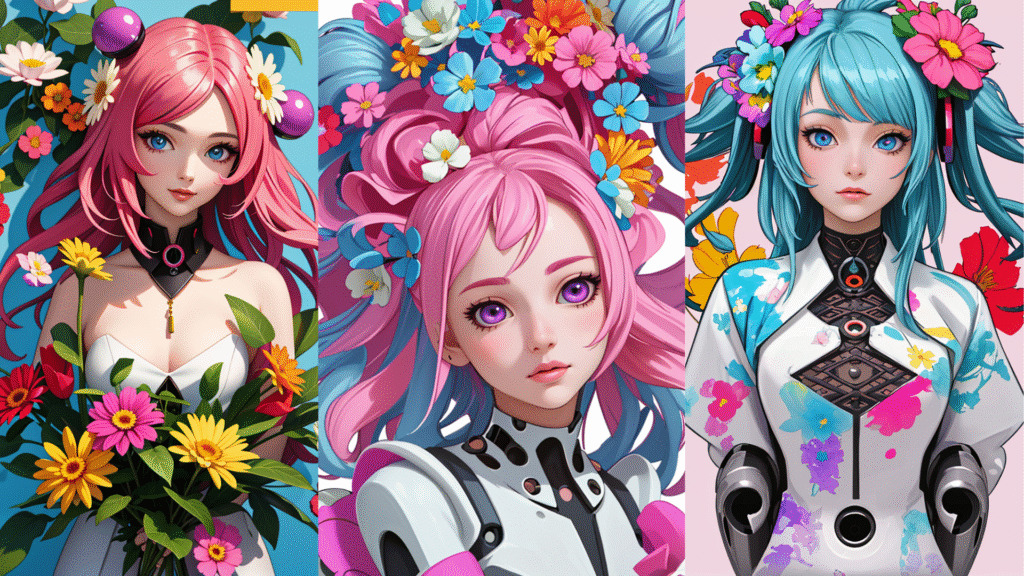

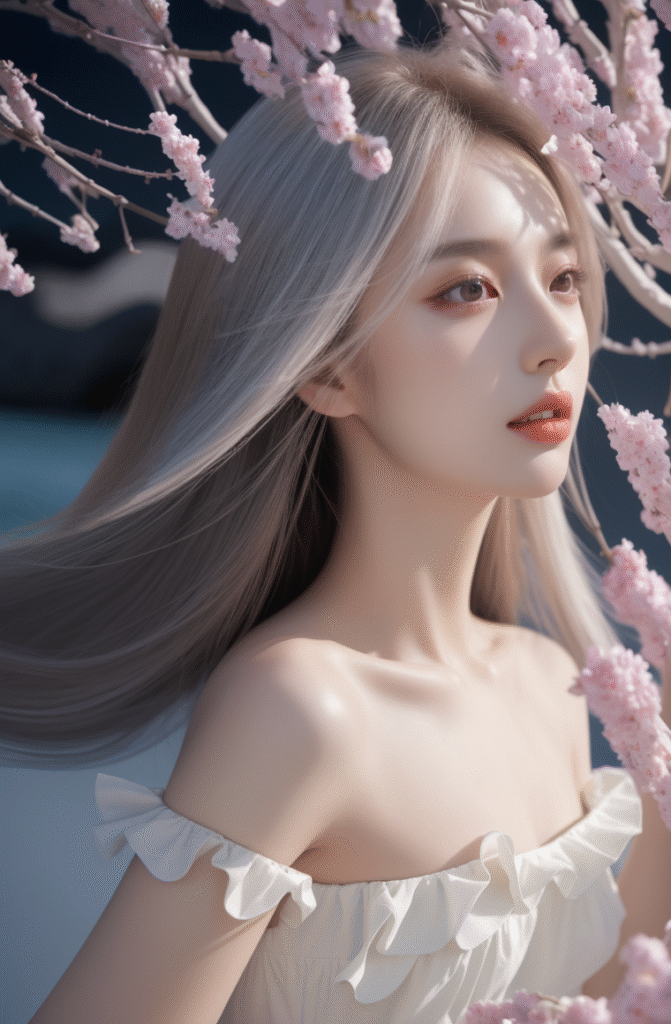

画像生成|テキストから好きな絵を自動で描く

Stable Diffusionの基本機能は、「テキストやイメージ画像から画像を自動生成する」ことです。

特定の画風に特化した「モデル」というものをStable Difutionに設定することによって「リアルSF作品」や「2.5次元作品」「韓国美女風作品」など、様々なタッチの作品を簡単に作成できます。

たとえば「リアルなSF世界のキャラクターを作成する」ためのプロンプトを入力するだけで、AIがそれを解釈して一枚の美しいイラストを描き上げます。

プロのようなタッチで、リアル調・アニメ調・絵本風・サイバーパンクなど作風も多彩。

キーワードを工夫すれば、誰でも想像した世界を“絵”として再現できるのが魅力なのです。

詳しいStable Difutionの導入方法についてはこちらの記事で解説しているので、ぜひ興味がある方はご覧ください。

動画生成(拡張機能)|画像を動かしてAIアニメにする

最近では、「AnimateDiff(アニメート・ディフ)」などの拡張機能を使うことで、画像を連続して動かし、アニメーション動画を作れるようになっています。

たとえば、「微笑む少女が風で髪をなびかせる」など、連続するフレームをAIが補完し、まるで短編アニメのようなループ動画(GIFやMP4)を生成可能です。

フレーム単位での画像生成になるため、一般的なAI動画生成アプリのランダム性に依存することなく、細かい動作をコントロールできることが最大の魅力です。

動きは自然で、キャラクターの表情やポーズが滑らかに変化します。YouTubeショートやSNS投稿にも向いており、クリエイター向けの映像制作としても注目されています。

実際にCivitai公式ページにStable Difutionで作成された作品が多数ありますので、気になる方はぜひご覧ください。

「AnimateDiff」の使い方をについては、こちらの記事にて解説しています。

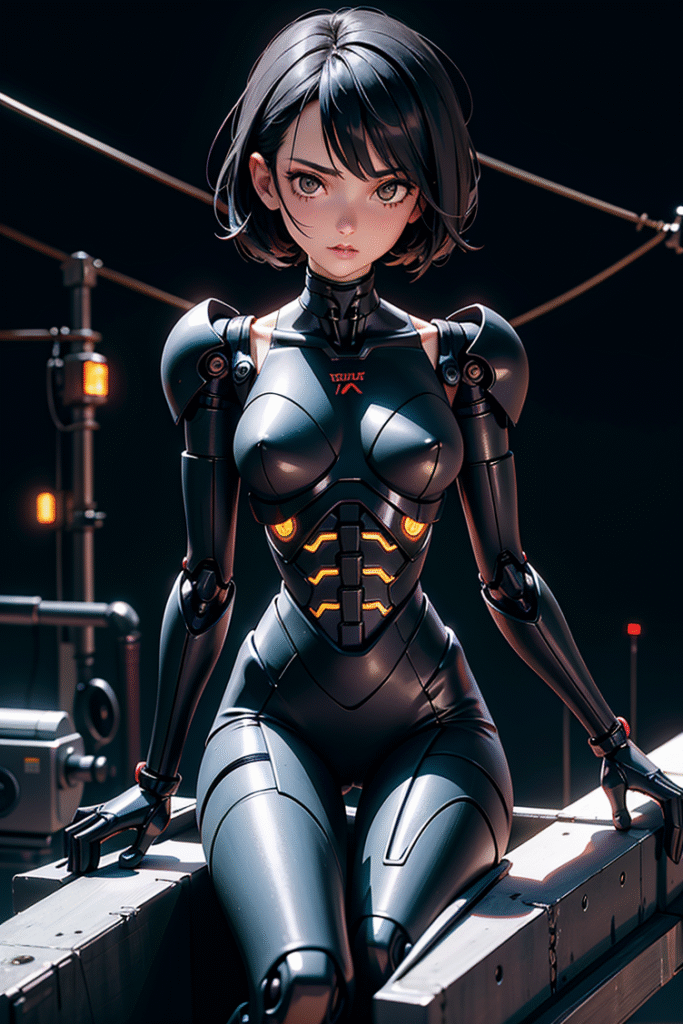

キャラクターデザイン(LoRA)|服や顔、特定のスタイルを学習させる

「LoRA(Low-Rank Adaptation)」という技術を使えば、特定のキャラクターの顔や服装、ポーズなどの特徴をAIに学習させて再現できます。

LoRAを組み合わせて使用することによって、顔を維持しながら服装やポーズ、解像度などを調整することができます。

たとえば、「制服姿の黒髪ツインテール少女」や「近未来の戦闘スーツを着たヒーロー」など、細かなスタイルやデザインを一貫して出力可能になります。

さらに、自分でLoRAを学習させることも可能で、オリジナルキャラや自分の顔を反映させたAIモデルも作れるようになります。

これは「自作キャラを大量に描く」「シリーズものの漫画やゲームの素材を作る」などに非常に便利です。

高品質のオリジナル作品をより効率的に生成したい方にうってつけの機能がStable Difutionにはあります!

コラージュ合成(ControlNet)|ポーズ指定や構図の自由な操作

画像の構図を細かく調整したいときに便利なのが「ControlNet(コントロールネット)」という拡張機能です。

たとえば、

- 「手を振っているポーズ」

- 「写真をなぞった輪郭だけで同じ構図を再現」

- 「背景だけを入れ替える」

といった指定ができ、構図の自由度が一気に広がります。

絵を描くのが苦手な人でも、自分で描いた簡単な線画や、他の写真をベースに「AIに思い通りの構図で描かせる」ことが可能になるのがポイントです。

なぜ今、Stable Diffusionが注目されているのか?

Stable Diffusionは、数ある画像生成AIの中でも異例の広がりを見せています。

その理由は、単なる「無料で使えるツール」という範囲を超えた、圧倒的な自由度と拡張性にあります。

以下に、注目される主な理由を解説します。

✅ 無料かつ商用利用も可能なライセンス

多くの画像生成AI(MidjourneyやDALL·Eなど)は月額制や商用制限がある中で、Stable Diffusionはオープンソースかつ無料で利用でき、商用利用にも比較的寛容なライセンス(モデルなど)も多いです。

そのため、個人クリエイターはもちろん、企業や開発者も安心して活用しやすくなっています。

「モデル」や「LoRA」などを使用する際には必ず商用利用の欄を確認しましょう!

✅ ローカル環境で完全に自分のものにできる

Stable Diffusionは、PCにインストールしてローカル環境で完全に独立して動作させることができます。

これはつまり、

- インターネット接続がなくても使える

- 外部サーバーにデータが送られない(プライバシー性◎)

- 設定やモデルの変更がすべて自由

といったメリットがあります。

「自分だけのAI環境」を作れるという点が、多くのユーザーに評価されています。

✅ 拡張機能が豊富で、どんどん進化している

Stable Diffusionは「拡張機能(エクステンション)」を自由に追加できる設計になっており、以下のような機能が次々と登場しています:

- ControlNet:構図を指定して描ける

- AnimateDiff:画像を動かして動画化

- LoRA:好きな服やキャラの特徴を学習・再現

- ADetailer:目や顔など細部の自動補正

- Civitai Helper:モデルやLoRAの自動管理

こうした追加要素により、まるで“自分好みにカスタマイズできる創作工房”のようなAIに進化し続けているのです。

おすすめ拡張機能についてはこちらの記事で解説しています!

✅ コミュニティが活発で、情報が豊富

日本語・英語問わず、Stable Diffusionに関する情報発信やノウハウ共有が非常に活発です。

X(旧Twitter)やYouTube、Qiita、Reddit、Civitaiなどで、

- 使い方のチュートリアル

- プロンプトのコツ

- トラブル時の対処法

- おすすめモデルやLoRA

といった情報が毎日のように更新されており、初心者でも安心して始められる環境が整っています。

✅ プロも使うほどのクオリティと汎用性

最後に、Stable Diffusionは「趣味」だけでなく、実際に商業イラスト・ゲーム素材・広告ビジュアルなどで使われるケースが増加しています。

実際に、

- 同人誌の表紙

- VTuberの立ち絵

- 音楽MVの背景アート

- YouTubeサムネ

などに導入されているのです。

プロレベルのクオリティがAIだけで実現できる点が、注目を集めている最大の理由です。

まとめ|Stable Diffusionは“誰でも始められる未来の創作ツール”

Stable Diffusionは、「テキストを入力するだけで、思い描いたビジュアルを自動で描いてくれる」革新的な画像生成AIです。

無料・高品質・自由なカスタマイズ性を兼ね備えており、以下のような幅広い活用が可能です:

- イラストやアートの制作

- キャラクターデザインや漫画素材の生成

- 動画コンテンツへの応用(AnimateDiffなど)

- アプリやWebサービスへの導入

- 趣味・副業・ビジネスに応じた柔軟な展開

拡張機能も日々進化しており、今後はさらにリアルで表現力豊かな創作が可能になるでしょう。

「絵が描けないけどアイデアはある」という人にとって、Stable Diffusionは最強のAI生成ツールです!

次にやること

「興味が湧いたけど、どう始めればいいの?」という方は、以下にStable Difutionの活用手順をまとめていますので、ぜひご覧ください!

コメント